用过 ChatGPT 5.2 的人大概都有过这样的体验:你问了一个问题,然后盯着屏幕上那个转圈的动画,等了十五秒、三十秒,甚至好几分钟,心里开始怀疑它是不是卡死了。而你切到 Claude 或者 Gemini 那边,同样的问题,几秒钟就开始吐字了。

这个差距是真实存在的。有开发者做过实测,GPT-5.2 在编码任务上动辄要跑二十分钟甚至更久,而 Claude Opus 4.5 处理同样的任务只要七分钟。在更通用的基准测试里,GPT-5 系列的平均延迟高达 113 秒,而 Gemini 2.5 Pro 只需要 55 秒。

所以到底发生了什么?GPT 5.2 在这漫长的等待时间里,究竟在干什么?

推理时计算:一条不同的技术路线

要理解这个问题,得先聊一个概念叫”推理时计算”(inference-time compute)。

传统的大语言模型,不管是早期的 GPT-4 还是后来的各种模型,本质上都是在做同一件事:根据你输入的文字,一个 token 一个 token 地往外”吐”最可能的下一个词。这个过程很快,因为每一步的计算量是相对固定的。你问一个简单问题和问一个复杂问题,模型花在每个 token 上的算力其实差不多。

但 OpenAI 从 o1 系列开始就走了一条不同的路。他们让模型在给出最终回答之前,先在内部进行一轮漫长的”自我对话”。模型会把你的问题拆成若干小步骤,逐步推理,遇到走不通的地方还会回溯、换一条路再试。这些内部推理过程会产生大量的”推理 token”——你看不到它们,但它们实实在在地消耗着计算资源和时间。

GPT 5.2 把这条路线推到了更极致的程度。它提供了从 none 到 xhigh 的多个推理强度档位。当你用 Thinking 模式或者 Pro 模式的时候,模型可能会在内部生成成千上万个推理 token,反复验证自己的逻辑链条,确保最终答案的准确性。有时候 Pro 模式在处理一道复杂的数学题时,内部的推理链条可以长达好几千个 token——这些你全看不到,你只看到那个一直在转的圈。

更小的底座,更重的推理负担

有一个在业内被广泛讨论的说法:GPT-5 系列的底层模型(base model)规模可能比 GPT-4.5 要小。OpenAI 选择了一条”用更小的模型配合更强的后训练和推理”的路线。

这就好比,与其造一台超大排量的发动机让它轻松跑到高速,不如造一台小排量发动机,然后给它配上一个极其精密的变速箱和涡轮增压系统。车照样能跑到同样的速度,但它需要更多时间来”酝酿”那股劲。

在这种架构下,模型的很多能力不是”预存”在参数里的,而是在推理阶段通过反复思考”临时生成”的。这意味着对于同一个问题,GPT 5.2 需要做更多的内部运算才能达到和那些更大底座模型相近的表现。而 Claude 和 Gemini,可能在基础模型层面就已经”知道”了很多东西,不需要在推理时花那么多力气去”想”。

一个有意识的设计取舍

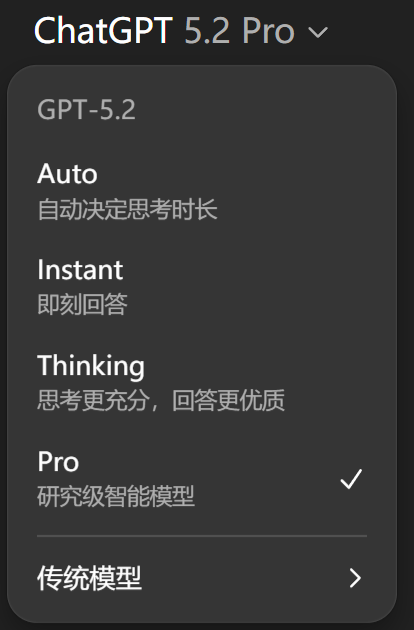

有意思的是,OpenAI 对此并不讳言。在他们的官方文档里,GPT 5.2 的默认推理强度被设为 none——也就是说在最低档位下它其实响应很快,Instant 模式通常能在两三秒内给出回复。但如果你需要高质量的深度推理,那就得把推理强度往上调,代价就是更长的等待。

OpenAI 内部还搞了一个”实时路由器”的机制:当你问一个简单问题,路由器会把请求发给快速模型;当你的问题明显需要深度思考,它才会启动 Thinking 模型。ChatGPT 里的 Instant、Thinking、Pro 三个档位,就是这种分层策略的产品化体现。

对比一下竞争对手的做法:Claude 的 effort 参数也能控制推理深度,但 Anthropic 的策略显然更偏向效率——他们声称在中等推理强度下就能匹配上一代模型的表现,同时使用的 token 比上一代少 76%。Gemini 则凭借 Google 自研 TPU 硬件的优势和 Mixture-of-Experts 架构,在保持高性能的同时把延迟控制得比较低。

简单说,三家做了不同的取舍。OpenAI 选择在推理阶段投入更多算力来换取更高的准确率,尤其是在那些极端困难的问题上。Claude 和 Gemini 则更注重整体的用户体验流畅度,把推理的性价比放在更优先的位置。

那这多出来的时间值得吗?

答案是:看你在做什么。

在一些极端困难的基准测试上,GPT 5.2 的长时间思考确实带来了显著的回报。它在 AIME 2025 数学竞赛上拿到了满分(不需要借助任何工具),在 ARC-AGI-2 抽象推理测试上大幅领先其他模型,在专业知识工作评估中匹配或超过了七成的人类专家。GPT 5.2 Pro 在软件工程任务上能花将近一个小时来审视代码架构、发现并修复其他模型根本注意不到的问题。

但代价是什么?有人测试发现 Pro 模式在三个编码任务上总共花了 82 分钟,费用接近 24 美元。而 Claude Opus 4.5 在同样的任务上平均得分 98.7%,只花了 7 分钟和 1.68 美元。还有开发者反馈说,GPT 5.2 有时候会”想了很久最后还是失败了”,甚至偶尔陷入某种内部死循环,反复纠结却得不出结论。

所以现在很多重度用户形成了一种实用主义的策略:日常快速问答用 Claude 或者 GPT 5.2 Instant,需要深度推理的关键任务再切到 GPT 5.2 Thinking 或 Pro。就像一位评测者总结的那样——简单的事别花冤枉钱买昂贵的思考时间,真正难的问题才值得让模型慢慢想。

结语

GPT 5.2 的”慢”,本质上反映了 AI 行业一个正在发生的深刻转变:性能提升的主战场,正在从”训练更大的模型”转向”在推理阶段更聪明地使用算力”。OpenAI 在这条路上走得最激进,所以用户感受到的延迟也最明显。

这到底是未来的方向,还是一个过渡期的权宜之计,目前还没有定论。OpenAI 内部据说正在开发代号为”Garlic”的下一代架构,目标是把大模型的知识压缩进更小的模型里,让推理变得更高效。在那之前,我们大概还得继续面对那个不停转圈的等待动画,然后心里默默权衡:这次的问题,值得等那么久吗?

发表回复