分类: 人工智能

-

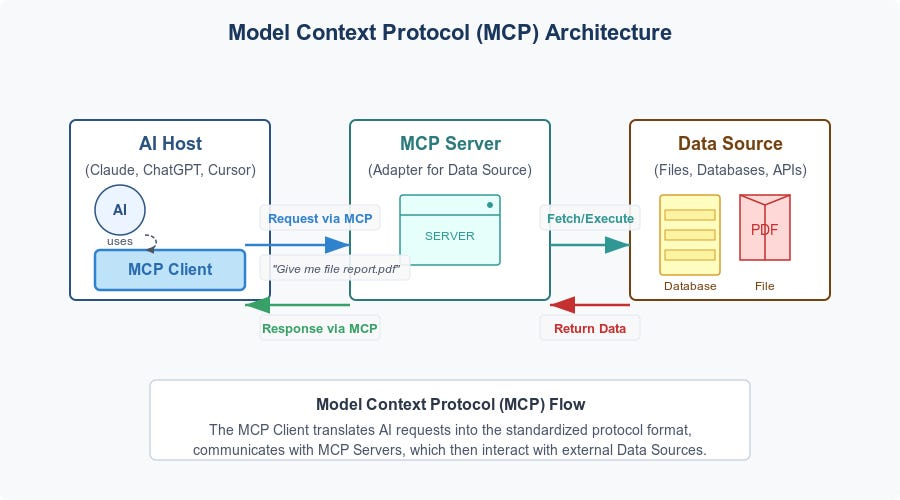

详解 MCP:协议解释和几个配置类型列举

介绍MCP: 在 MCP 出现之前,如果你想让一个 AI 访问你的 GitHub 仓库、查询你的数据库、或者读…

-

Claude Code 配置文件指南:MCP / 推理等级 / 授权 / 全局配置 / 项目配置

Claude Code 的配置分散在好几个文件里,这是很多人觉得混乱的根源。先来看一张全景图: 用户级别(全局…

-

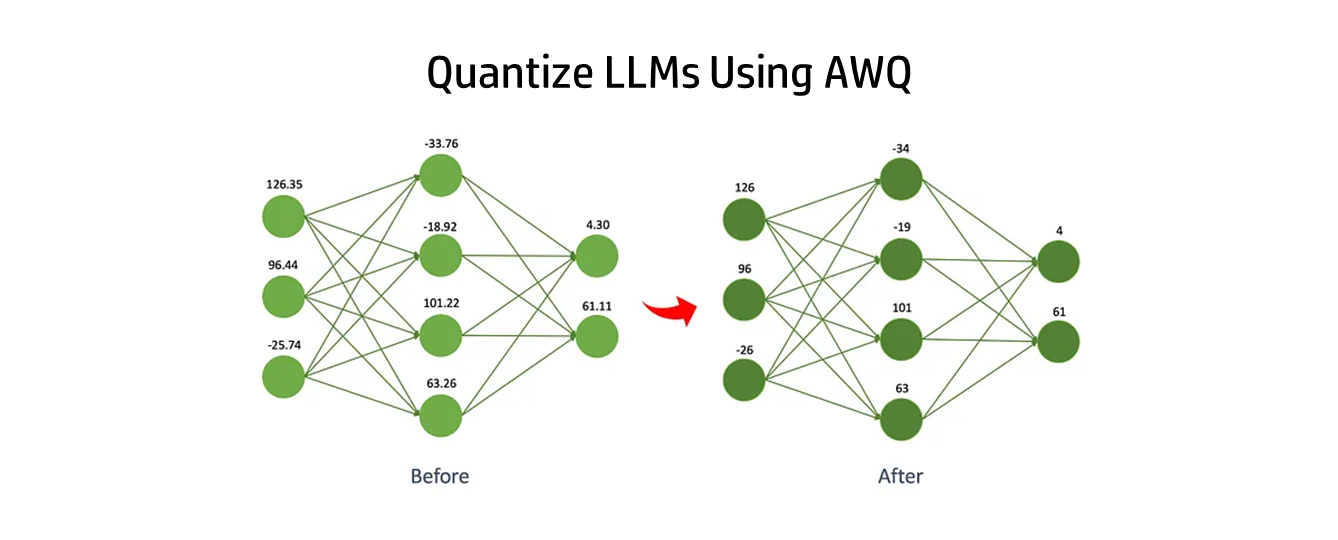

量化是什么?INT8 / INT4 等对大模型质量的影响到底有多大

Hugging Face 上下载模型的时候,你可能见过这样的命名:Llama-3-8B-Q4_K_M、Qwen…

-

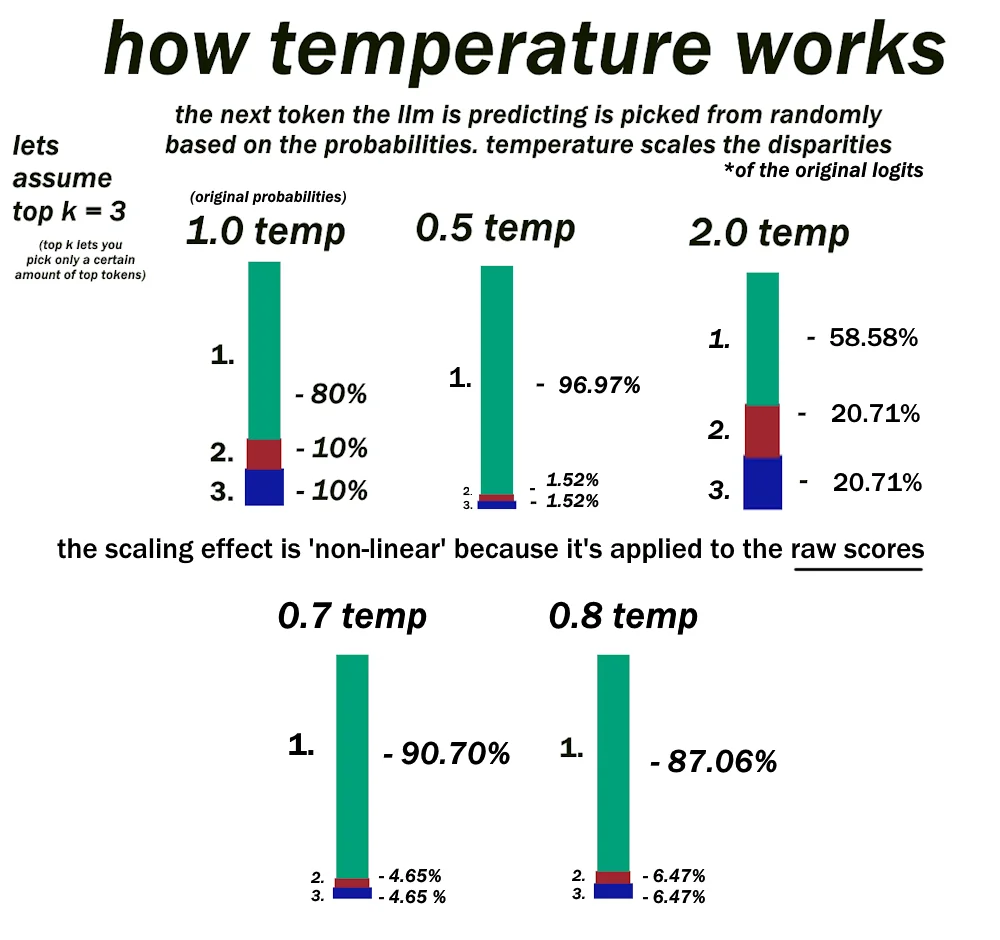

大模型的 Temperature 和 Top-P:那两个你总在调却不太懂的参数

用过大模型 API 的人,多多少少都见过这两个参数——Temperature 和 Top-P。界面上通常是两根…

-

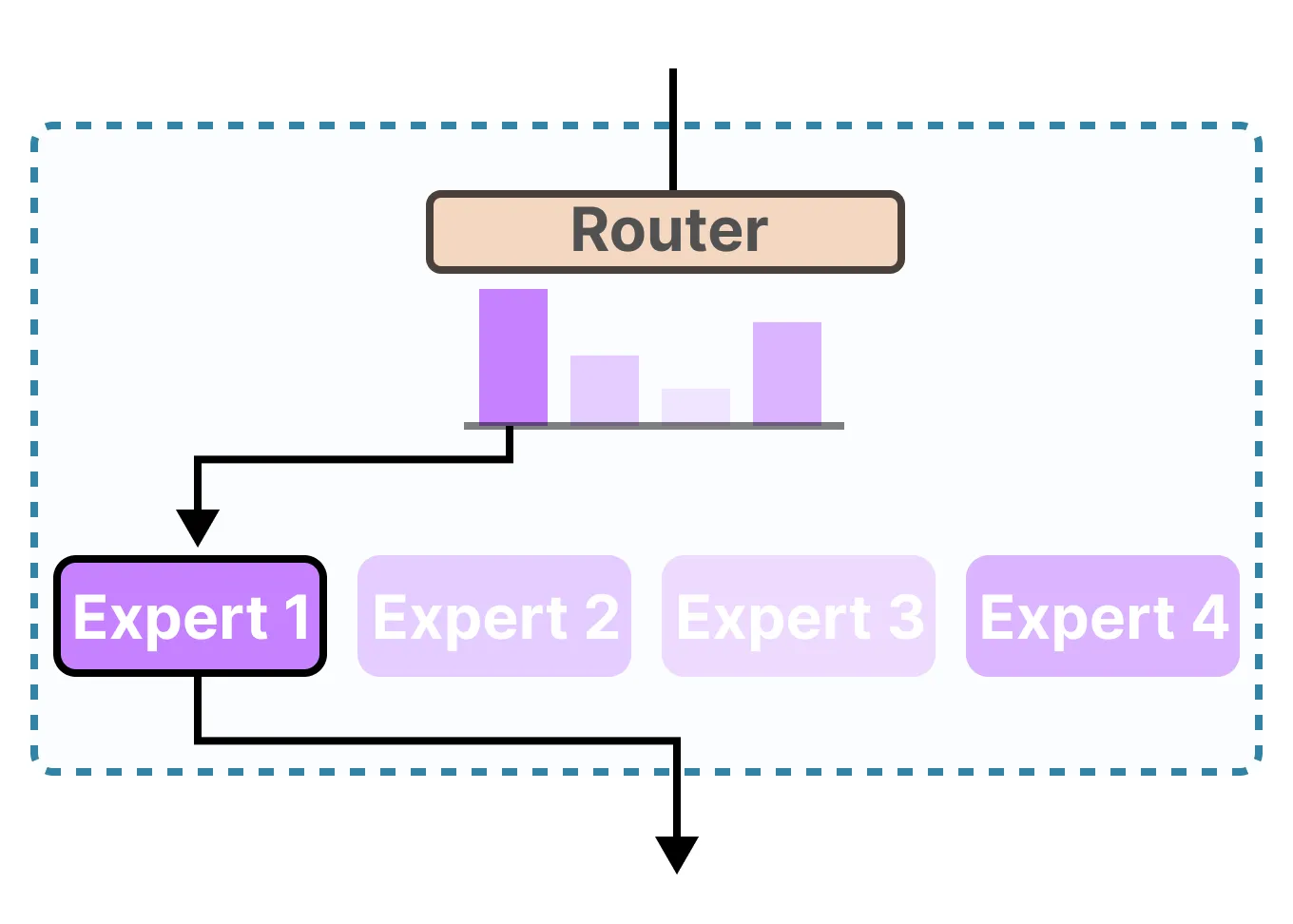

MoE(混合专家模型)是什么?

在聊 MoE 之前,得先理解它要替代的东西。 传统的大语言模型,比如早期的 GPT 系列,用的是所谓的R…

-

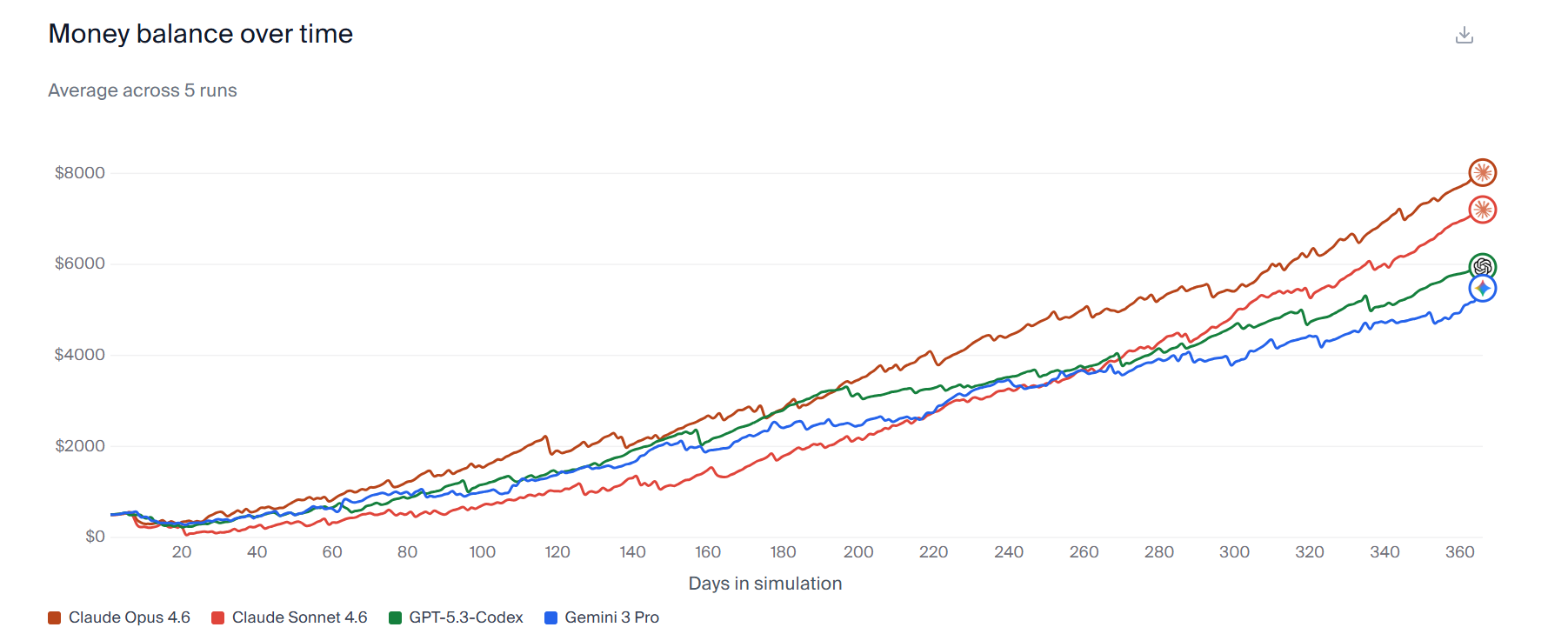

Agentic 稳定性

你可能已经听过不少关于 AI Agent 的宣传了——它们能写代码、能做研究、能帮你管理日程。不过,如果你真的…

-

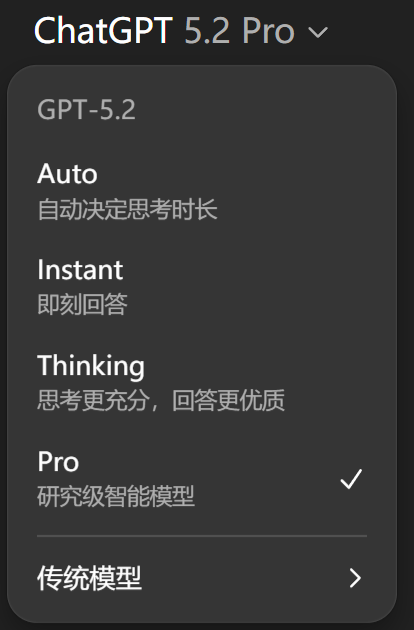

为什么相比 Claude / Gemini 等模型,GPT 5.2 系列模型看起来思考时间长的多?

用过 ChatGPT 5.2 的人大概都有过这样的体验:你问了一个问题,然后盯着屏幕上那个转圈的动画,等了十五…

-

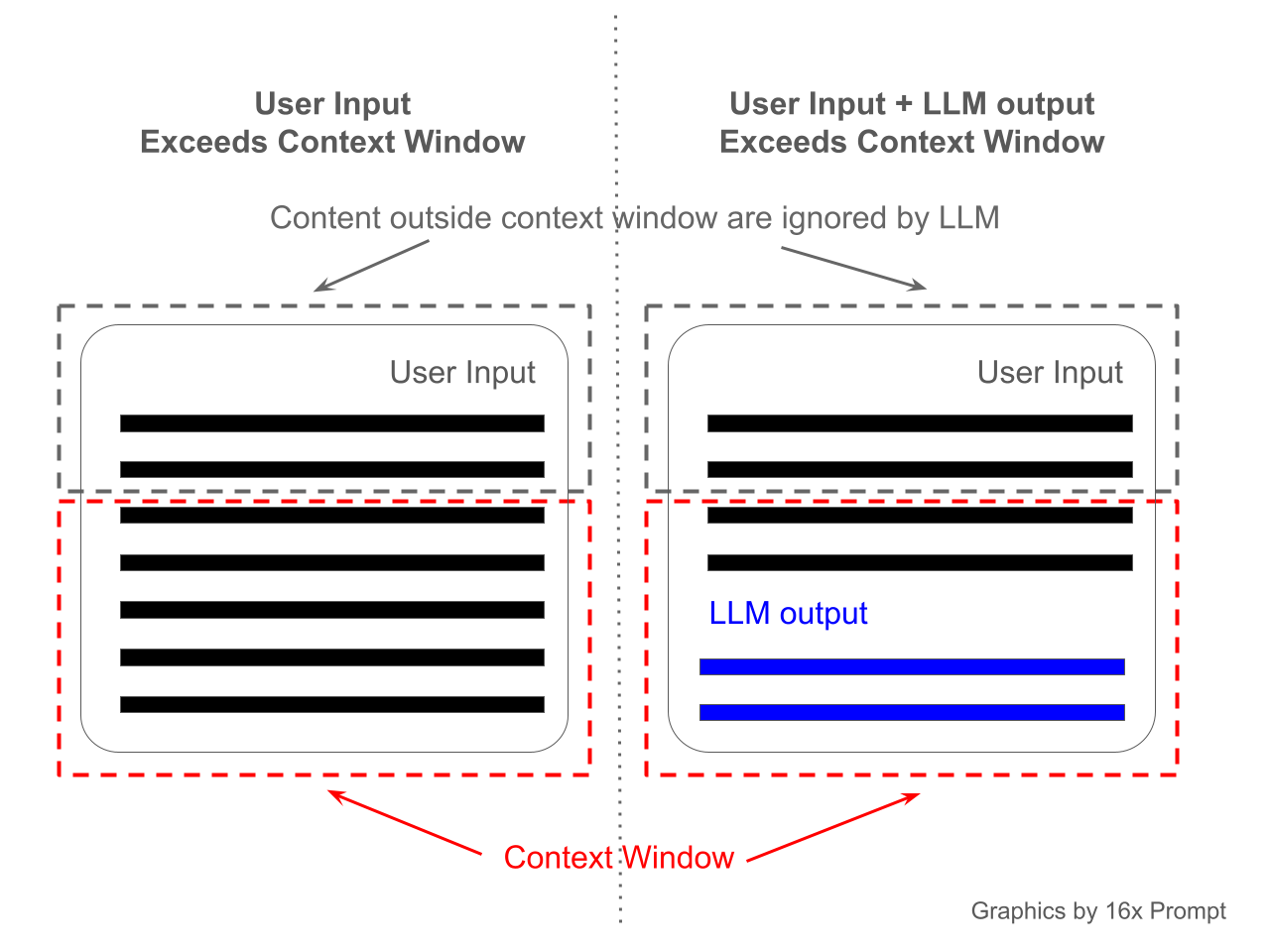

深入解读:为什么 LLM 具有上下文窗口限制?

用过 ChatGPT 或 Claude 等大语言模型的朋友大概都碰到过这种场景:聊着聊着,模型突然开始R…

-

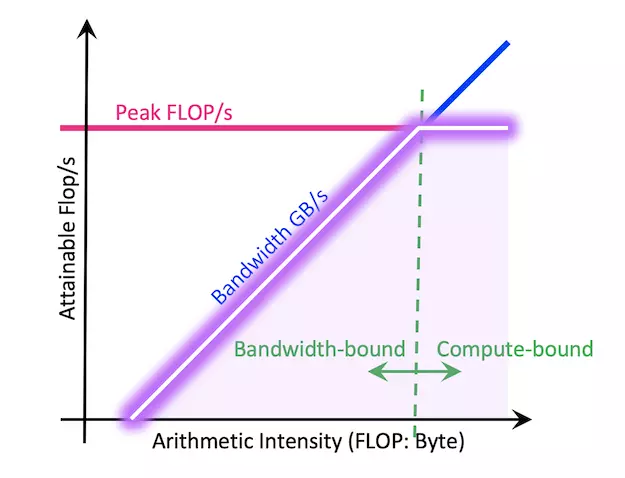

输入快,输出慢,LLM 中的并行和串行计算

你有没有注意到,当你向 ChatGPT 或 Claude 等大模型提交一个很长的提示词时,模型几乎是̶…

-

跑大模型到底要多少显存?从推理到训练,一篇讲透 GPU 选择

说实话,每次有人问我「我想跑个大模型,买什么显卡好」,我都得先反问三个问题:你要跑多大的模型?是推理还是训练?…